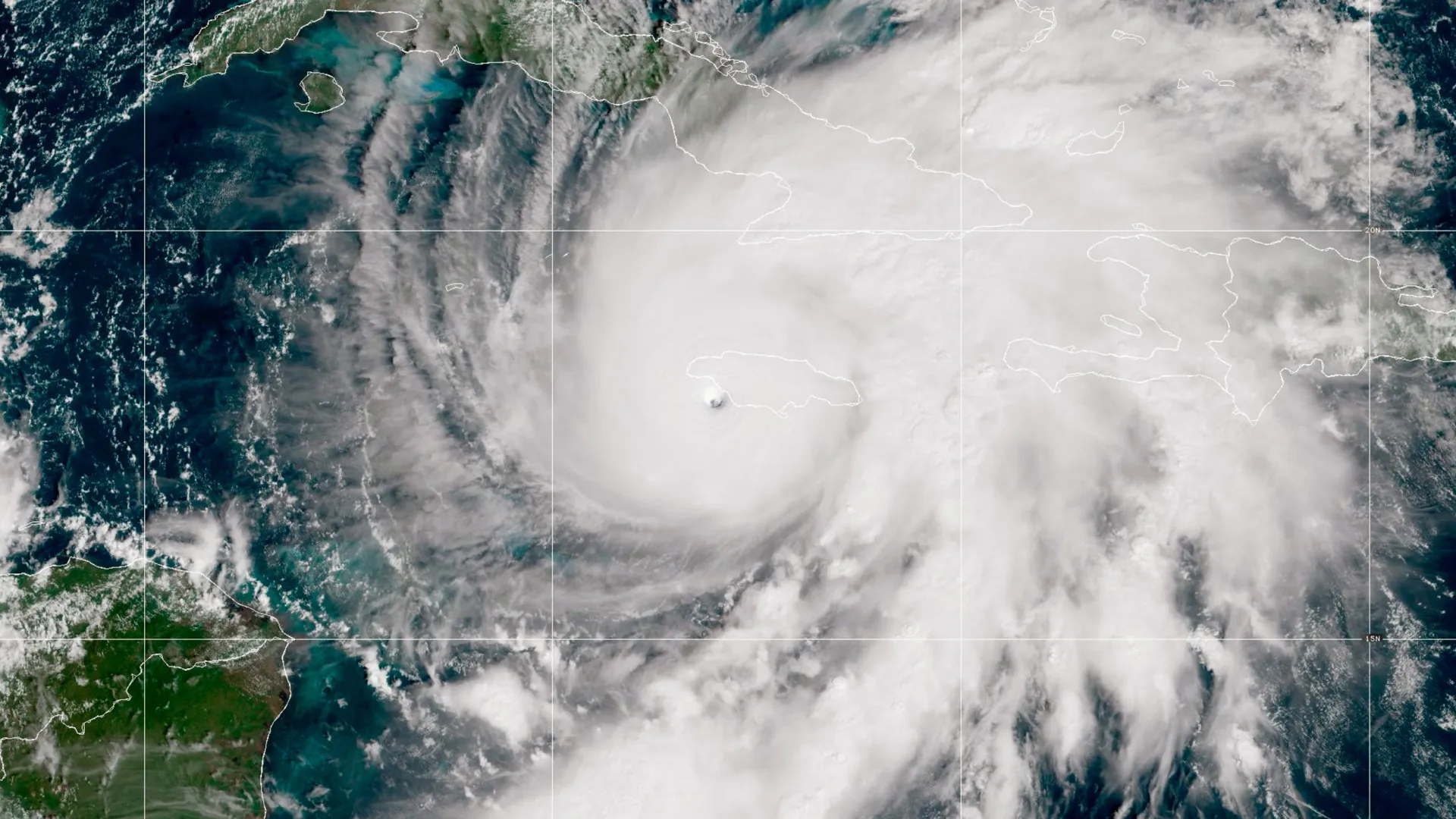

Um vídeo viral mostra o que parecem ser quatro tubarões a nadar na piscina de um hotel jamaicano, enquanto as águas da tempestade inundam a área. Outro vídeo supostamente mostra o aeroporto de Kingston, na Jamaica, completamente devastado pela tempestade. Nenhum destes eventos aconteceu, tratando-se de desinformação gerada por IA que circulou nas redes sociais enquanto a tempestade Melissa assolava o Caribe esta semana. Estes vídeos acumularam milhões de visualizações em redes sociais como o X, TikTok e Instagram, sendo que alguns parecem recuperar imagens de desastres antigos, enquanto outros foram criados por plataformas de IA. Embora seja comum que fotos, vídeos e desinformação surjam durante desastres naturais, geralmente são desmascarados rapidamente, mas os vídeos gerados pelas novas ferramentas de IA facilitam a criação e a divulgação de clipes realistas. Neste caso, o conteúdo tem aparecido nas redes sociais ao lado de imagens reais filmadas por residentes locais e organizações de notícias, semeando confusão entre os utilizadores ‘online’. Para evitar ser enganado por este tipo de conteúdo, deve estar-se atento às marcas de água que indicam que um determinado vídeo foi gerado, por exemplo, pelo Sora, uma ferramenta de conversão de texto em vídeo da OpenAI. Apesar disso, é bastante fácil remover estes logótipos usando outras ferramentas. Por exemplo, embora o vídeo dos tubarões pareça realista à primeira vista, parece menos credível quando examinado, porque os animais têm uma forma estranha, objetos que se misturam e detalhes como letras distorcidas, sinais reveladores de imagens geradas por IA. O furacão Melissa é o primeiro grande desastre natural desde que a OpenAI lançou a versão mais recente da sua ferramenta de geração de vídeo Sora, no mês passado. “Com o surgimento de ferramentas poderosas e facilmente acessíveis como o Sora, ficou ainda mais fácil para pessoas mal-intencionadas criarem e distribuírem vídeos sintéticos altamente convincentes”, afirmou a editora sénior da NewsGuard, Sofia Rubinson, citada pela Associated Press. “Antes as pessoas costumavam identificar falsificações através de sinais reveladores, como movimentos não naturais ou texto distorcido, mas à medida que estes sistemas melhoram, muitas destas falhas desaparecem, tornando cada vez mais difícil distinguir conteúdo gerado por IA da realidade”, explicou a especialista. Além disso, a agência de notícias relembra que as contas nas redes sociais usam este tipo de vídeos para expandir a sua base de seguidores, a fim de promover projetos, produtos ou serviços, pelo que é necessário estar atento ao histórico de conteúdo ‘clickbait’. Embora não esteja claro quem criou o vídeo dos tubarões, uma versão encontrada no Instagram traz a marca de água de uma conta do TikTok, que se descreve como “criadora de conteúdo com efeitos visuais de IA na República Dominicana”. Outra versão deste vídeo no X vem com uma nota da comunidade que diz: “Esta filmagem e a voz usada foram criadas por inteligência artificial, não são imagens reais do furacão Melissa na Jamaica”. O furacão Melissa fez, pelo menos, 32 mortos nas Caraíbas, com 23 vítimas no Haiti, quatro na Jamaica, quatro no Panamá e uma na República Dominicana, deixando um rasto de destruição que também atingiu Cuba. Leia Também: YouTube vai usar IA para melhorar os vídeos que vê na televisão

Painel

Painel  Cores

Cores